국내 AI 기업 중 첫 사례

위함 요소 차단에 게임 산업 특화 안전 기준 반영

|

30일 NC AI에 따르면 Safeguard 기술은 레드팀·블루팀·퍼플팀으로 구성된 삼중 보안 체계가 핵심이다. 레드팀은 신종 공격 패턴을 연구하고 블루팀은 방어 기술을 개발하며 퍼플팀은 두 팀의 결과를 통합해 정책에 반영한다. 또한 엔씨소프트 퍼블리싱코디네이션센터와 협력해 게임 업계 특성을 반영한 '챗봇 네거티브 규제 정책'을 마련, 게임 서비스 내 부적절 콘텐츠와 금지 행위를 선제적으로 차단한다.

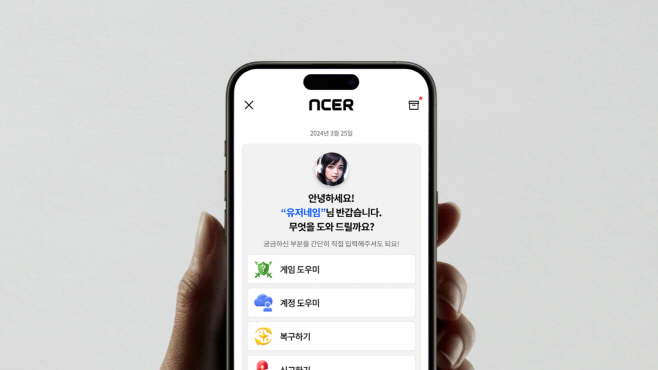

Safeguard가 적용된 NCER는 국제 벤치마크 기준의 차별·혐오·욕설·외설 등 일반적 위험 요소 차단을 충족함과 동시에 게임 산업 특화 안전 기준을 추가 반영했다. 이를 통해 실시간 대화 환경에서 발생할 수 있는 위험을 사전에 탐지하고 즉시 차단하는 성능을 입증했다.

|

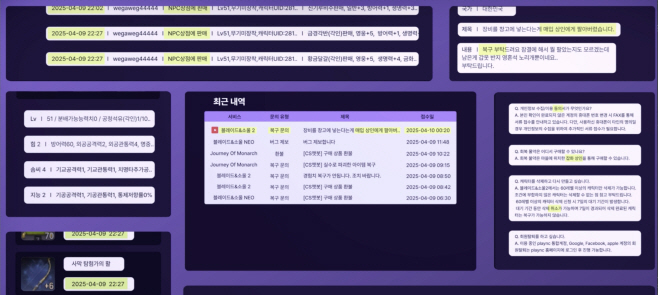

NC AI는 2022년부터 'NC AI Ethics Framework'를 기반으로 데이터 프라이버시, 편향 방지, 투명성을 3대 가치로 한 윤리 경영을 실천하고 있다. 이를 게임 서비스에도 적용해 '리니지W', '리니지2M' 등에서 13개 언어의 광고 패턴을 탐지·차단하는 스팸 필터링 시스템을 운영 중이다.

회사는 향후 텍스트 기반 안전성 기술을 비전-언어 모델(VLM) 기반의 멀티모달 탐지 기술로 확장, 이미지와 영상까지 포함한 포괄적 안전 시스템을 구축할 계획이다. 또한 54개 기관이 참여하는 정부 주관 '독자 AI 파운데이션 모델 프로젝트'에서 AI Safety 개발을 주도하고 있으며, 에이아이웍스와 협력해 전쟁, 폭력, 허위정보 등 고위험 상황에 대한 안전한 AI 응답 시스템도 개발 중이다.

이연수 NC AI 대표는 "이번 Safeguard 기술 적용은 NC AI가 AI 안전성 분야에서 기술적 우위를 확보하고, 책임감 있는 AI 개발 기업으로서의 위치를 공고히 하는 중요한 출발점"이라며 "앞으로도 기술 독립과 산업 실증, 글로벌 공헌을 동시에 실현하는 대한민국 AI 전문 기업으로서의 소명을 다할 것"이라고 밝혔다.