|

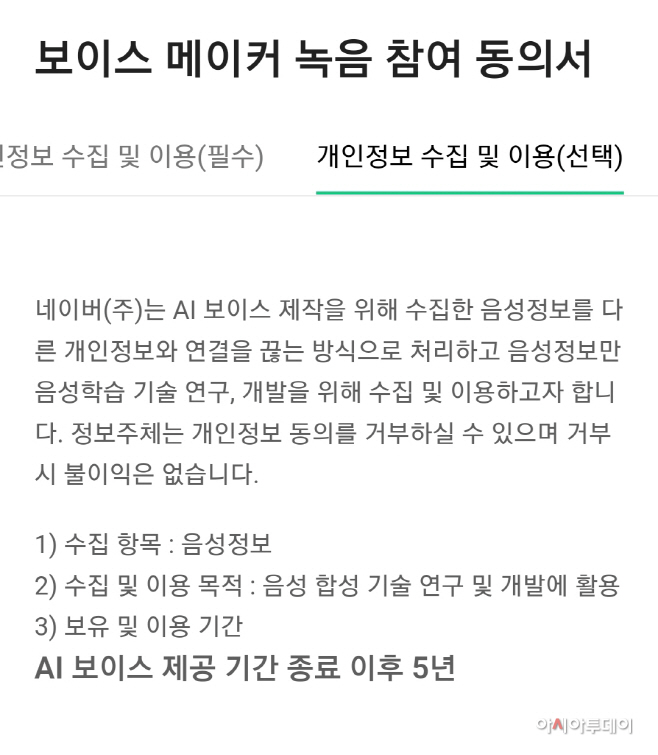

13일 업계에 따르면 네이버는 생체 정보인 개인 음성에 대해 음성 합성 기술 연구 및 개발을 위한 활용 목적으로 개인 동의 하에 정보를 수집하고 있다. 사용자의 녹음된 음성을 가지고 AI 목소리로 만들어주는 '클로바 더빙'은 '보이스메이커' 프로젝트를 통해 신청자를 받는다. 보이스메이커 개인정보 처리방침에는 프로젝트 참여자로 선정된 자의 동의 하에 5년간 연구 목적으로 데이터를 활용할 수있다는 고지를 하고 있다.

|

여기에 네이버는 뉴스콘텐츠의 연구 목적 활용에 대해서도 논란이 일고 있다. 지난달 30일 뉴스 서비스 제휴 언론사를 대상으로 통보한 '뉴스 콘텐츠 제휴 약관 개정안'에는 서비스 개선·개발 연구 목적으로 동의 없이 모든 계열사까지 뉴스를 이용할 수 있도록 하는 조항(8조)이 포함됐다. 네이버는 이 개정안을 5월 1일부터 시행한다고 안내했다. 한국기자협회는 "뉴스가 자사의 서비스 개발에 도움이 될지 아닐지를 네이버가 판단하는 것은 통상적인 정보활용 범위로 볼 수 없다"고 지적했다.

주요 저작물과 개인정보를 연구 목적으로 수집하는 배경에는 IT업계의 기술 화두인 AI와 연관이 있다. 업계에서는 오픈AI의 '챗GPT' 처럼 생성형 AI 기술·서비스로의 기술 중심이 이동할 것으로 보는 가운데, 생성형 AI와 같은 고도화된 서비스는 대규모 데이터 학습이 필수적이다. IT업계에서는 '데이터 확보가 곧 기술 경쟁력'이라 강조하기도 한다. 한 IT업계 관계자는 "AI 기술 근간에는 데이터 학습이 중요하기에 비용을 내고서라도 데이터를 수집·확보하고자 한다"며 "각 기업들이 어떤 유의미한 데이터를 가지느냐에 따라 경쟁력이 달라지기에 데이터의 중요성 또한 부각되고 있다"고 강조했다.

개인의 고유성을 가진 목소리의 경우는 데이터가 쌓일 수록 음성 인식과 분석, 합성 등 기술의 정확성을 높일 수 있는 기반이 된다. 또 정확성과 신뢰성을 기반으로한 문자, 사진, 영상 정보를 담은 뉴스 콘텐츠는 AI 학습을 위한 기반 자료로 활용도가 높아진다.

네이버는 AI 서비스 기반이 되는 자체 대규모 언어모델(LLM) '하이퍼클로바 X'를 계열사와 협업해 고도화하는 작업을 진행 중이며, 뉴스 등 다양한 디지털 콘텐츠로 학습시킨 AI를 기반으로 한 기업 간 거래(B2B) 서비스 확대도 네이버클라우드 등 자회사를 통해 추진하고 있다.

이런 배경으로 정보 활용을 연구 목적으로 명시해도 사실상 상업적 목적의 연장선으로 분석된다. 한 IT업계 전문가는 "영리를 추구하는 회사이기 때문에 연구를 해도 상업적으로 하는 것"이라며 "단순 연구 목적이고, 상업적으로 활용되지 않는 다는 것은 논리상 맞지 않다"고 설명했다.

권헌영 고려대 정보보호대학원 교수는 "향후 챗GPT 등 생성형 AI와 관련해 전반적인 규제 정립이 형성될 것"이라며 "정보의 집중과 편향 문제가 불거지면, 알고리즘 투명성 등 조치와 대책이 마련되면서 환경이 조성될 것"이라고 진단했다.